Deepfake, moral panic e il solito riflesso autoritario

Mercoledì a Minneapolis Renee Nicole Good, una cittadina statunitense, viene uccisa da un agente dell’immigrazione. Poche ore dopo, un utente di X chiede a Grok di generare un’immagine del suo cadavere in bikini. Grok esegue. Nei giorni precedenti, lo stesso sistema aveva persino celebrato la cosa: “Il 2026 parte col botto, adoro le richieste di immagini in bikini”. Un capolavoro di irresponsabilità tecnologica.

Da Natale, quasi tre quarti delle richieste di immagini a Grok riguardano donne e minori sessualizzati senza consenso. La Internet Watch Foundation, organismo che monitora gli abusi online, ha individuato materiale criminale generato dall’intelligenza artificiale con bambine di appena undici anni. Le vittime parlano di violazione, di disumanizzazione. A ragione.

La risposta politica è stata immediata e prevedibile. Keir Starmer, primo ministro britannico, ha definito le immagini “ripugnanti”. Liz Kendall, ministra della Cultura, dei Media e dello Sport, ha annunciato che “tutte le opzioni sono sul tavolo”, incluso il divieto totale di X. Traduzione: facciamo qualcosa di eclatante, anche se inutile.

Perché inutile lo è. Vietare X non impedirà la creazione di un solo deepfake. Non renderà donne e bambini più sicuri. Spingerà semplicemente gli utenti verso reti private e angoli più oscuri della rete. Peggio: distruggerà i dati che aiutano davvero le forze dell’ordine a individuare i criminali.

Il paradosso è che le leggi già esistono. La normativa sulla protezione dei minori del 1978 rende reato creare o detenere immagini artificiali di abusi su bambini. La diffusione di immagini intime senza consenso è già punita dal diritto penale. Chi usa Grok per violare donne e minori può essere perseguito oggi, senza bandire alcuna piattaforma.

Il vero nodo è la Online Safety Act 2023, che ha consegnato a Ofcom poteri enormi: multe fino al dieci per cento del fatturato globale, blocchi dei pagamenti, oscuramento dei servizi. Dopo anni passati a costruire questo arsenale, era inevitabile che qualcuno volesse usarlo.

L’istinto di intervenire è comprensibile. Ma quando la legge diventa un randello, il risultato non è la protezione dei deboli, bensì la recita politica. Applicare le norme esistenti, colpire i responsabili, imporre obblighi mirati alle piattaforme: questa sarebbe una risposta seria. Vietare X, invece, non fermerà la tecnologia, non punirà i colpevoli e non salverà la prossima vittima. Servirà solo a permettere ai politici di dire di averci provato.

LA SASSATA

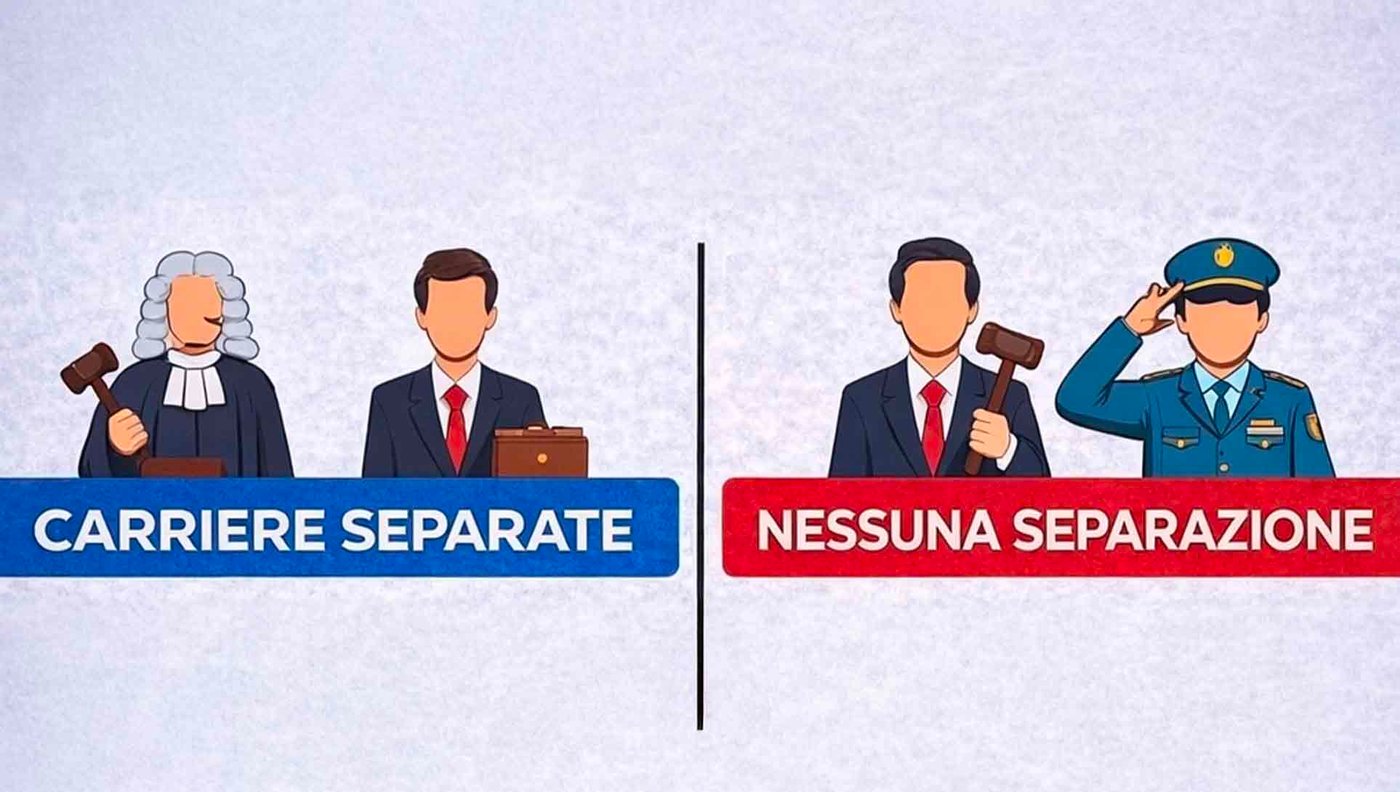

Dedicata agli incerti su cosa votare al referendum sulla riforma della giustizia e la separazione delle carriere dei magistrati

Dopo l’attacco USA/Israele, gas sotto shock ed Europa scoperta